Un danger pour l’humanité dénoncé par des Nobel

Ce n’est absolument pas banal. Voici des lauréats du prix Nobel qui dénoncent les dangers de leurs propres découvertes !

Je coirs même que c’est une première. Le 8 octobre le Nobel de physique 2024 a été décerné à l’Américain John Hopfield et au Britanno-Canadien Geoffrey Hinton pour leurs travaux sur « l’apprentissage automatique avec des réseaux de neurones artificiels ». Des travaux qui ont, notamment, mené au développement de l’intelligence artificielle (IA).

En général, les lauréats exultent, et on les comprend. Or, dès leur consécration, John Hopfield et Geoffrey Hinton donnent plutôt de cracher dans la soupe. Le premier a déclaré : « En tant que physicien, je suis très troublé par quelque chose qui n’est pas contrôlé, quelque chose que je ne comprends pas assez bien pour savoir quelles sont les limites que l’on peut imposer ». Et le second : « Je crains que la conséquence globale de tout cela ne soit des systèmes plus intelligents que nous, qui finissent par prendre le contrôle ». Geoffrey Hinton a tout de même bossé une dizaine d’années chez Google, mais il a démissionné en mai 2023 pour, dit-il, « pouvoir alerter sur les dangers de l’IA ». Ce qu’il a effectivement fait, notamment dans un article du New York Times, où il dénonçait les « profonds risques pour la société et l’humanité », dus à l’IA : suppressions d’emplois, robots meurtriers, utilisation par des acteurs malveillants, et même « générateurs de conneries », en rendant quasiment impossible « la capacité à discerner ce qui est vrai de ce qui ne l’est plus »…

Ce n’est pas la première fois que des scientifiques à la pointe de l’IA alertent sur ses dangers. Entre autres, il y a eu cette déclaration, le 30 mai 2023, signée par 350 personnalités du secteur, dont Sam Altman, créateur de ChatGPT, et Demis Hassabis, directeur de Google DeepMind : « Limiter les risques d’extinction [de l’humanité] posés par l’IA devrait être une priorité mondiale, aux côtés d’autres risques de grande ampleur comme les pandémies ou la guerre nucléaire ». On peut évidemment se demander quelle est la part d’hypocrisie dans ce genre de discours (surtout quand on sait qu’Elon Musk lui-même s’est fendu d’un couplet alarmiste sur l’IA, alors qu’il en est l’un des principaux propagateurs).

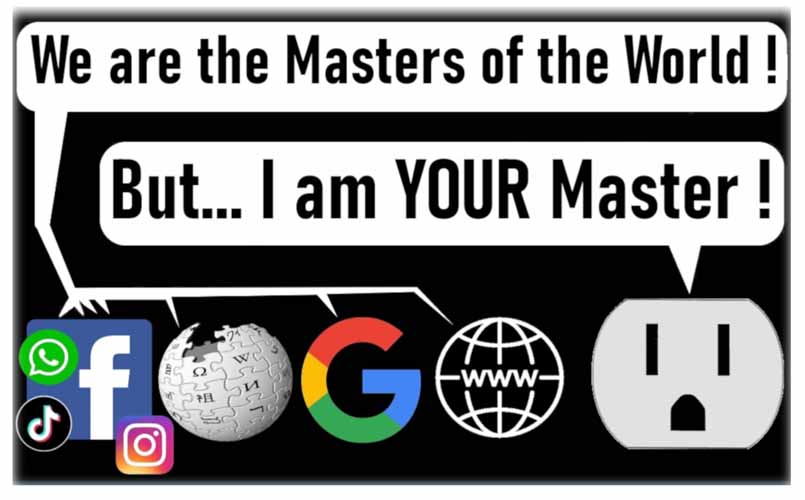

Quoiqu’il en soit, les craintes de John Hopfield et de Geoffrey Hinton ne sont pas des paroles en l’air. En théorie, le prix Nobel est décerné aux chercheurs « ayant apporté le plus grand bénéfice à l’humanité ». Quand des lauréats eux-mêmes s’inquiètent des dangers de leurs travaux, la moindre des choses serait de les écouter. Pendant la seconde moitié du XXè siècle, c’était la bombe atomique qui incarnait les dérives les plus meurtrières de la science. Le risque nucléaire n’a évidemment pas disparu, mais l’IA pourrait être tout aussi toxique, quoique de façon plus sournoise, puisque ses dangers sont masqués par les services qu’elle rend au quotidien. Les scientifiques s’en alarment, pendant que les politiques s’en foutent.

Antonio Fischetti ; Charlie Hebdo